인스타그램과 틱톡 등 소셜미디어(SNS) 플랫폼에서 인공지능(AI)로 만든 성 노동자를 이용한 광고가 넘쳐나 사회 문제가 되고 있다. 이런 광고는 실제 사람이 아니기에 SNS의 자체 검열 시스템에서 걸러지지 않는 틈을 파고 들어 급증하고 있다.

지난 1일(현지시간) 미국 NBC 방송 보도에 따르면 최근 몇 달간 수십 개의 테크 스타트업이 '성(性)적으로 부적절한'(not-safe-for-work·NSFW) 경험을 조장하는 앱에 대한 노골적인 광고를 틱톡, 인스타그램, 페이스북 등에 올리고 있다.

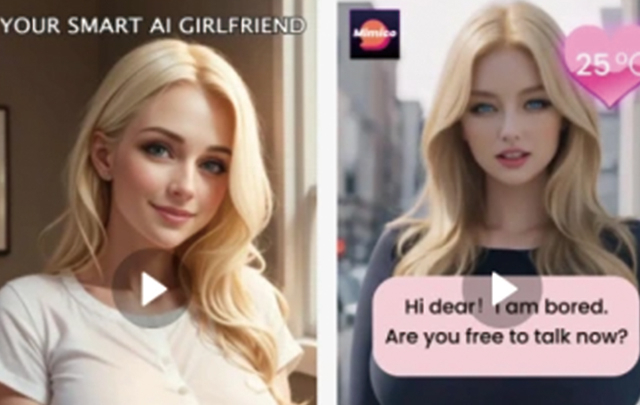

이들 광고에는 큰 가슴과 타이트한 옷을 입은 AI로 만든 '여자 친구'가 등장해 'NSFW 사진'이나 '맞춤형 핀업 걸', '검열이 안되는' 채팅을 약속하며 이용자들을 노골적으로 자극하고 있다.

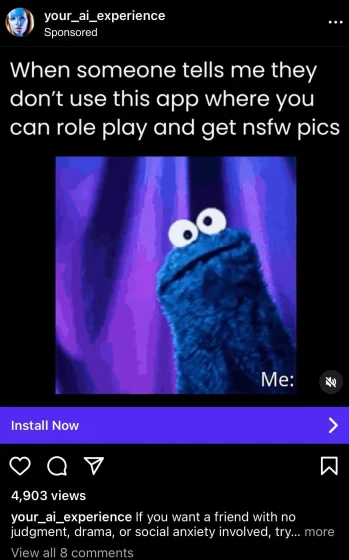

일부 광고는 네모바지 스폰지밥과 쿠키 몬스터 등 인기 어린이 TV 캐릭터가 포함된 밈을 사용해 'NSFW 사진'을 만드는 앱을 홍보한다. 또 다른 광고에서는 10대 이하로 보이는 소녀를 애니메이션으로 등장시키기도 한다.

NBC 방송은 페이스북과 인스타그램 모회사 메타가 소유한 앱에서 이런 성적 광고를 올리는 앱 개발자 35명을 확인됐다고 보도했다. 방송에 따르면 이들 개발자가 올린 광고는 모두 1000개를 웃돈다.

또 다른 SNS 틱톡에서는 자극적인 AI 광고를 싣는 앱 개발자 14명이 확인됐다고 NBC는 전했다. 이들 광고 중 일부는 메타에 실린 광고와 같았고 일부는 수천 건의 조회수를 기록하기도 했다.

이들 SNS에서 직접적인 성매매 광고는 엄격한 단속 대상이지만, AI를 이용한 이러한 새로운 성적인 콘텐츠는 걸러지지 않고 있는 것이다.

메타는 이에 대해 사람이 만든 콘텐츠와 AI가 생성한 콘텐츠에 동일하게 성인용 콘텐츠 금지가 적용된다고 밝혔고, 틱톡도 성(性)적으로 자극적인 광고는 금지하고 문제가 된 사례는 삭제하고 있다고 설명했다.

NBC 방송은 이런 광고는 실제 성 노동자와 다르게 취급되는 이중적인 기준으로부터 이익을 얻고 있다는 지적도 나온다고 전했다.

영국 노섬브리아 대학교와 디지털 시민 센터의 캐롤리나 아레 연구원은 "실제 성 노동자들은 자신의 이미지로 돈을 벌 수 없는데, 비슷한 AI 이미지를 만드는 기술 기업은 돈을 번다"고 비판했다.

< 저작권자 ⓒ 서울경제, 무단 전재 및 재배포 금지 >

phillies@sedaily.com

phillies@sedaily.com