인스타그램에서 따돌림·괴롭힘 게시물의 사전 조치율이 93%에 달하는 데 숨은 공신은 인공지능(AI)인 것으로 드러났다. 현재까지는 맥락을 파악하는 데는 한계가 있지만 문화적 맥락·번역에 대한 학습이 이뤄지면 AI의 사전 조치율도 높아질 것으로 보인다.

12일 페이스북이 진행한 연례 커뮤니티 가이드라인 브리핑에서 유동현 페이스북 아시아태평양(APAC) 콘텐츠 정책팀 매니저는 “업로드된 게시물이 누군가를 따돌리거나 괴롭히는 게시물인지 판가름하는 하는 데 맥락과 의도를 파악하는 것이 중요하다”며 “사람이 이를 감별하는 한편 AI에도 도움을 받고 있다”고 설명했다.

이런 게시물을 감별하는 과정에서 AI의 역할은 게시물이 따돌림·괴롭힘인지 모호하게 느껴질 때 이를 사람에게 보고하는 역할이다. 특히 문제가 있어 보이기는 한데 판단을 못하겠다고 생각될 때 이를 사람에게 전달한다.

올해 4∼6월 게시물 유형별로 AI의 사전 조치율을 봤을 때 혐오 발언은 94.5%, 아동 성착취 및 성적 학대 이미지는 99.3%를 AI가 사전 조치한 반면, 따돌림·괴롭힘 게시물의 조치율은 13.3%에 그쳤다. 아직은 보조 역할이지만 AI는 게시물에 들어 있는 글과 댓글 간 맥락을 파악해 의사결정을 하기도 한다. 박상현 페이스북 커뮤니케이션 이사는 “이를 테면 게시글에 ‘ㅇㅇ이 셔츠 입었네’ 등으로는 반어적인 어조 등을 확인할 수 없지만 이어 달리는 댓글의 부정성·긍정성을 통해서 AI가 맥락을 파악할 수 있다”고 설명했다.

이를 통해 AI가 자살 관련 게시물을 분류하기도 한다. 이용자가 자살을 암시하는 것 같은 글을 남기면 일단 자살 게시물로 분류한 뒤 이어 달리는 지인들의 댓글 반응을 보고 이를 다시 분류해 관련 기관에 알릴지를 결정하기도 한다.

박 이사는 “AI가 현재 공부하는 단계라 아직 부족하지만, 맥락과 국가별 문화에 대한 이해가 늘어나고 번역 기술이 향상되면 훨씬 좋은 서비스를 제공하게 될 것”이라고 강조했다.

페이스북은 어떤 콘텐츠가 삭제되는지 커뮤니티 규정도 설명했다. 커뮤니티 규정이란 페이스북·인스타그램의 콘텐츠 허용 규칙으로 △폭력 및 범죄 행위 △안전 △불쾌한 콘텐츠 △무결성 및 진실성 △지적재산관 등 5가지 부문에서 총 26개 항목을 담았다.

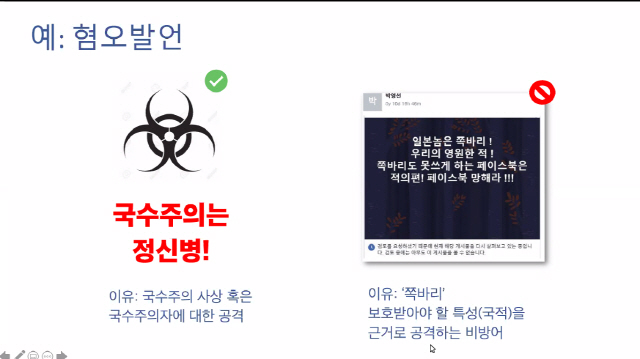

그 예로 ‘일본놈은 쪽바리’라는 게시글은 혐오표현으로 차단되지만 ‘국수주의는 정신병’은 차단되지 않는다고 설명했다. 이 두 가지의 차이를 두고 비방을 당한 사람이 선택할 수 없는 영역을 두고 비난을 하는지 여부를 들었다. 박 이사는 “국수주의 등은 본인의 신념으로 선택할 수 있는 영역이지만 일본인으로 태어나는 건 선택의 여지가 없다”며 “보호할 수 있는 카테고리의 문제는 선택할 수 있느냐 아니냐를 판단 기준으로 삼는다”고 설명했다.

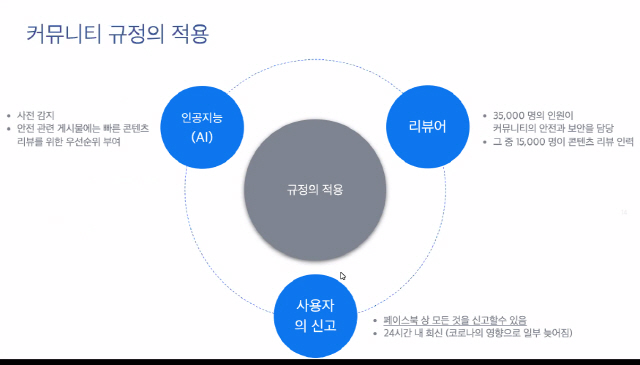

페이스북은 커뮤니티 규정 운영 인력을 2017년 대비 3배 수준인 3만5,000명으로 확대했다. 이 중 1만5,000여명의 리뷰 인력이 규정에 따라 일평균 100만 건 이상 접수되는 이용자 신고를 365일 24시간 체제로 관리한다. 점차 AI가 이들 인력을 대신하는 비중이 높아질 것으로 보인다.

/정혜진기자 madein@sedaily.com

< 저작권자 ⓒ 서울경제, 무단 전재 및 재배포 금지 >

madein@sedaily.com

madein@sedaily.com