알리바바 산하 핀테크 계열사인 앤트그룹이 중국산 반도체를 이용해 엔비디아의 H800 성능을 뛰어넘는 결과물을 만들어낸 것으로 전해졌다. 딥시크가 촉발한 인공지능(AI) 가성비 경쟁에서 중국 업체들이 자국 기술을 통해 성과를 내면서 챗GPT가 주도해온 미국 주도의 경쟁 구도가 깨지고 있다는 분석이 나온다.

24일 블룸버그통신은 익명의 소식통을 인용해 알리바바와 화웨이 등 중국산 칩을 사용한 앤트그룹이 ‘전문가혼합(MoE)’ 방식으로 대규모언어모델(LLM) 훈련을 진행해 엔비디아의 H800 칩과 비슷한 결과를 얻었다고 보도했다. 해당 관계자는 “앤트그룹이 여전히 AI 개발에 엔비디아 칩을 사용하지만 최신 모델에는 AMD와 중국 반도체를 포함한 대체 제품에 의존하고 있다”고 말했다.

외신에서는 앤트그룹이 AI 모델에 활용한 AI 칩으로 화웨이의 ‘어센드 910’을 가장 유력한 제품으로 보고 있다. 화웨이는 AI 추론 칩인 ‘어센드 910C’를 본격 양산하고 있으며 엔비디아 최첨단 칩인 블랙웰보다 한 단계 아래인 호퍼 시리즈와 맞먹는 성능으로 알려졌다. 딥시크의 AI 추론 모델 ‘R1’에도 활용됐을 만큼 성능이 입증됐다.

앤트그룹의 모회사인 알리바바그룹의 칩을 탑재했을 가능성도 있다. 알리바바의 반도체 자회사 핑토우거(T-HEAD)는 2019년 AI 추론 칩 ‘한광 800’을 개발했다고 발표했다. 12㎚(나노미터·10억분의 1m) 공정으로 제작됐고 170억 개의 연산 소자가 내장돼 있다. 이후 AI 추론 칩 개발 소식이 발표된 적은 없으나 자체 AI 칩을 개발해왔을 가능성을 배제할 수 없다.

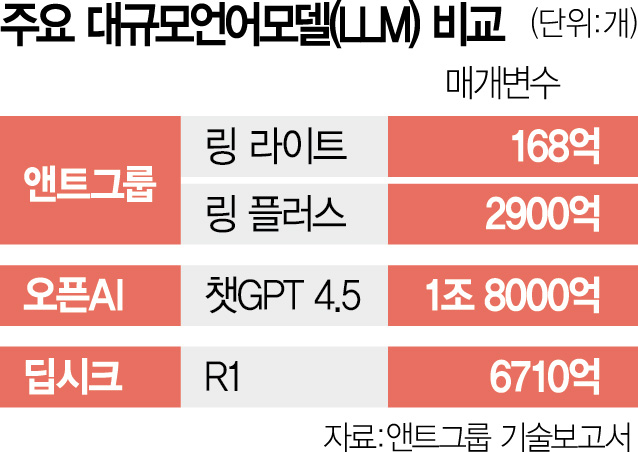

앤트그룹 보고서에 따르면 MoE 방식을 통해 ‘링라이트’와 ‘링플러스’를 개발했다. MoE 기법은 작업당 필요한 매개변수만 활용해 효율을 높이는 방식이다. 오픈AI의 챗GPT, 메타의 라마 등은 매개변수를 늘려 작업을 활성화하지만 딥시크는 6710억 개의 매개변수 가운데 370억 개만 활성화해 가성비를 확보했다. 앤트그룹은 링라이트와 링플러스의 매개변수가 각각 168억 개, 2900억 개로 딥시크의 R1보다 적다고 강조했다. 보고서는 앤트그룹 연구팀이 중국산 반도체를 사용한 AI 모델 훈련으로 비용을 약 20% 낮춘 508만 위안으로 절감했고 알리바바의 AI 큐원 2.5, 딥시크의 V2.5와 필적할 성능을 달성했다고 강조했다. 앤트그룹은 링라이트와 링플러스를 오픈소스로 공개하고 의료·금융 등의 산업에 적용할 예정이라고 밝혔다.

블룸버그 산업 리서치의 수석 BI 분석가인 로버트 리아는 “앤트그룹의 성과는 중국의 AI 혁신 역량과 기술 발전을 보여준다”며 “중국이 엔비디아 칩에 대한 수출통제를 우회하기 위해 저비용의 계산 효율성이 높은 모델로 전환하며 AI 분야에서 중국이 기술 자립을 향해 나아가고 있다”고 평가했다.

< 저작권자 ⓒ 서울경제, 무단 전재 및 재배포 금지 >

bright@sedaily.com

bright@sedaily.com