여행지에서 불어로 쓰여있는 안내판에 구글의 증강현실(AR) 번역서비스 ‘워드 렌즈’를 켜면 카메라를 대자마자 스마트폰에 영어 번역이 나타나 쉽게 읽을 수 있다.

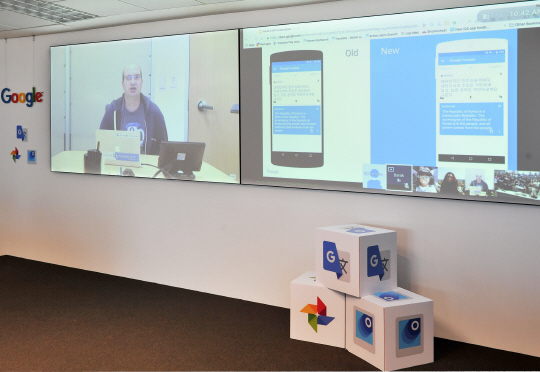

구글코리아는 29일 서울 강남구 역삼동 본사에서 ‘AI 혁신의 시대:구글 포토와 번역’ 기자간담회를 열고 ‘신경망 기계번역(NMT) 기술을 적용해 더 똑똑해진 구글 포토·번역 기능을 소개했다. 이날 미국 실리콘밸리 본사에서 원격으로 나타난 버락 투로프스키 구글 번역 프로덕트매니지먼트총괄은 “신경망 기계 번역을 도입하며 번역 속도는 3∼8배로 높이고 오류는 85%까지 줄였다”고 말했다. 구글은 이 서비스를 한국어를 비롯해 스페인어·포르투갈어·프랑스어·독일어·중국어·일본어·터키어에 적용해 최근 공개했다. 기존에는 문장을 단어, 어구(Phrase) 단위로 쪼개 번역해 어색한 문장이 나왔으나 이번에는 문장을 통째로 인식해 번역을 한다. 투로프스키 구글 번역 총괄은 “전체적 문맥을 중시해 요청된 문장을 재배열하고 나라마다 문법에 맞게 실제 사람들이 말하는 방식에 가장 가깝게 번역 결과를 내놓는다”고 말했다. 법륜스님의 명상을 정리한 책을 번역하거나 수능 영어 지문을 자연스럽게 번역하기도 했다.

수많은 사진을 똑똑하게 정리해주는 구글 포토 ‘어시스턴트(비서)’기능도 눈길을 끌었다. 상황이나 인물을 비롯해 이미지 속에 글이 있으면 내용까지 검색할 수 있다. ‘결혼식’을 검색하면 신부가 웨딩드레스를 입은 사진부터 하객이 건배를 하는 사진, 일렬로 포즈를 취하는 사진들이 등장하는 식이다. 다만 나비넥타이를 입은 식당 종업원과 찍은 사진 등도 노출돼 아직은 완벽치는 않다는 지적도 나온다. 사진 속 건물, 기념물 등을 인식해 위치정보가 없이도 검색할 수 있다. 런던을 검색하면 ‘런던아이’ 앞에서 찍은 사진 등이 나왔다. 제임스 캘러거 구글 포토 소프트웨어 엔지니어링 디렉터는 “두 살 짜리에게 고양이가 어떻게 생겼는지를 알려주는 것과 비슷한 방식으로 사진 속 랜드마크 특징들을 학습시켰다”며 “심층 신경망을 활용해 구글 검색에 쓰인 단어와 검색 결과 이미지 간의 연관성을 활용해 훈련을 거쳤다”고 설명했다. 한편 새로 출시된 ‘구글 포토 스캐너’ 어플리케이션(앱)은 현상 사진을 카메라로 인식해 어떤 부분의 화소가 밝았고 어두웠는지를 파악해 반사광을 제거해 사진을 깔끔하게 스캔해냈다.

/정혜진기자 madein@sedaily.com

< 저작권자 ⓒ 서울경제, 무단 전재 및 재배포 금지 >

madein@sedaily.com

madein@sedaily.com