국내 대표 플랫폼 기업인 카카오(035720)와 네이버가 직원들 대상 인공지능(AI) 윤리 교육에 나서고 있다. 소수자 혐오 발언 등으로 논란이 된 AI챗봇 ‘이루다'의 사건에 대한 경각심으로 서비스 설계 단계부터 AI 윤리를 염두에 두도록 한 것이다.

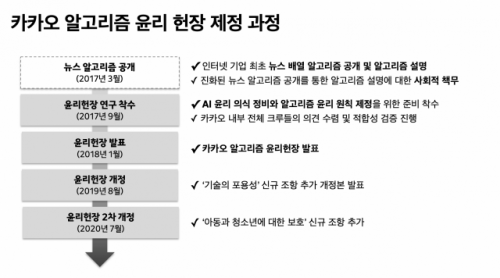

카카오는 다음달 2일까지 전 직원이 참여하는 온라인 사내 교육 ‘카카오 크루가 알아야 할 윤리경영’에 AI 알고리즘 윤리 교육 과정을 신설했다고 17일 밝혔다. 교육 내용은 카카오의 디지털 책임 구현 사례를 소개하는 한편 카카오 인권경영선언문, 알고리즘 윤리 헌장의 각 조항을 하나씩 학습할 수 있도록 구성했다. 기술과 서비스 개발 단계에서 AI 알고리즘 윤리를 염두에 두고 업무의 방향성을 어떻게 세울지 생각해 보게 하는 데 초점을 맞췄다. 카카오 관계자는 “2018년 1월 국내 기업 중 최초로 ‘알고리즘 윤리 헌장’을 발표한 것에 이어 AI 알고리즘 윤리 실천을 위한 선제적인 조치에 나서게 됐다”며 “기업의 디지털 책임 구현을 위해 선제적으로 대응을 하고 있다”고 말했다.

이날 네이버도 서울대 AI정책 이니셔티브(SAPI)와 협업해 수립한 ‘네이버 AI 윤리 준칙’을 발표했다. 이 준칙은 네이버 모든 구성원이 AI 관련 서비스를 개발하거나 이용할 때 준수해야 하는 원칙이다. △사람을 위한 AI 개발 △다양성의 존중 △합리적인 설명과 편리성의 조화 △안전을 고려한 서비스 설계 △프라이버시 보호와 정보 보안의 총 5개 조항으로 구성되어 있다.

또 네이버는 구성원이 AI 윤리 준칙을 실천할 수 있도록 사내 커뮤니케이션 채널을 마련해 프로젝트 출범이나 서비스 개발에 관련 사안을 문의하고 논의의 장을 열 수 있도록 할 방침이다.

/정혜진 기자 madein@sedaily.com

< 저작권자 ⓒ 서울경제, 무단 전재 및 재배포 금지 >