카카오브레인이 자사가 개발한 멀티모달 언어모델(MLLM) 오픈소스 ‘허니비(Honeybee)’를 ‘깃허브(Github)’에 공개했다고 19일 밝혔다.

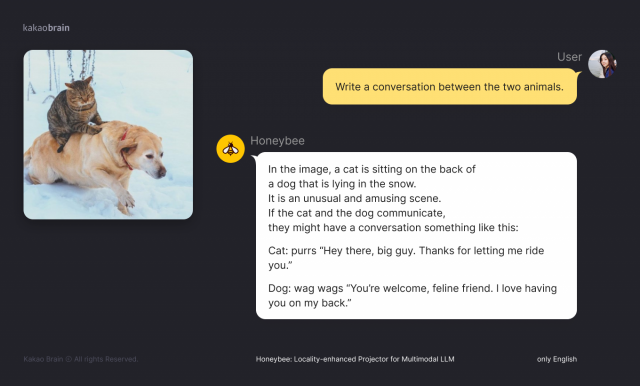

허니비는 이미지와 텍스트 명령어(프롬프트)를 입력하면, 텍스트로 답변하는 모델로 텍스트로만 입⋅출력하는 자연어 기반 대규모언어모델(LLM)보다 확장된 모델이다.

자연어는 물론 이미지까지 포함해 질문할 수 있어 이미지에 담긴 장면을 묘사하거나 이미지와 텍스트가 혼합된 콘텐츠에 관한 질문을 이해하고 답변할 수 있다. 예를 들어 허니비에 ‘농구 경기 중인 두 명의 선수’ 이미지와 함께 ‘왼쪽 선수는 몇 번 우승했나요?’라는 질문을 영어로 입력하면 ‘허니비’가 입력된 이미지 내용과 질문을 종합적으로 이해하고 답변을 생성해낸다.

이 모델은 ‘MME’, ‘MMBench’, ‘SEED-Bench’ 등의 성능 실험(벤치마크)에서 모델이 공개된 타사 MLLM 대비 최고 성능을 달성했다. 특히 지각 능력과 인지 능력을 평가하는 ‘MME’ 벤치마크에서는 2800점 만점 중 1977점을 받았다.

또한 관련 논문 ‘허니비: 멀티모달 LLM을 위한 로컬리티 강화 프로젝터’는 지난해 논문 공개 사이트 ‘아카이브(arXiv)’에 게재된 바 있다. 논문에는 이 기술에 대해 “이미지 데이터를 처리해 딥러닝 모델이 더 효과적으로 학습하고 이해할 수 있도록 돕는 기술”이라며 “시각 프로젝터(Visual projector)가 사전 훈련된 비전 인코더와 대규모 언어 모델(LLM)을 연결하는 데 중요한 역할을 하며, 이를 통해 시각적 이해를 깊게 하면서 LLM의 능력을 활용할 수 있다”고 설명했다. 카카오브레인은 허니비가 향후 효과적인 교육 및 학습 보조 도구로 사용될 것으로 전망하고 있다.

< 저작권자 ⓒ 서울경제, 무단 전재 및 재배포 금지 >

hjin@sedaily.com

hjin@sedaily.com