삼성전자와 SK하이닉스가 고대역폭메모리(HBM)뿐만 아니라 스마트폰용으로 쓰이는 LPDDR D램 분야에서도 쌓기 경쟁을 벌이고 있다. 저전력이 장점인 LPDDR D램은 전력 절감이 과제인 인공지능(AI)용 시장에서 활용되는 경향이 뚜렷해지면서 HBM과 함께 D램 제조사의 새로운 ‘먹거리’로 각광받고 있다.

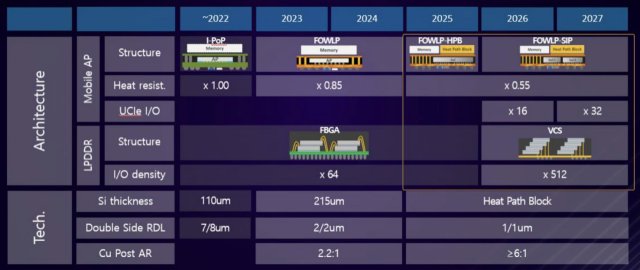

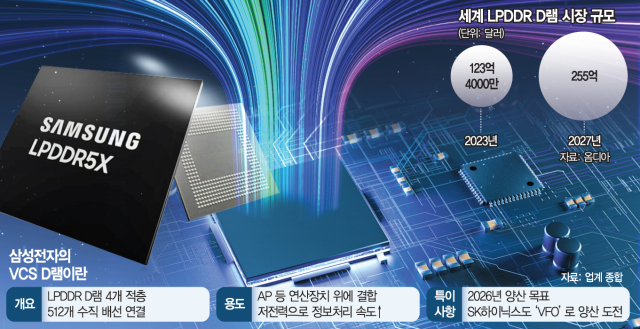

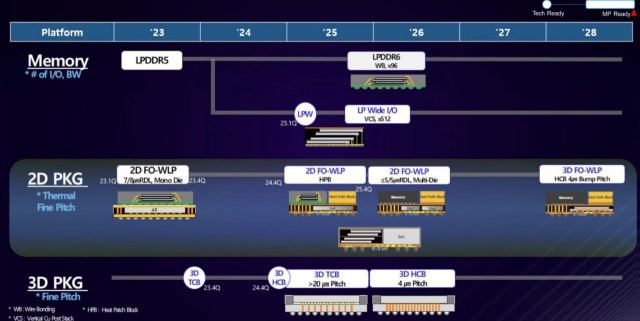

8일 업계에 따르면 삼성전자는 ‘VCS D램’을 내년 1분기까지 개발 완료한 뒤 2026년 양산하겠다는 목표를 세웠다. VCS 메모리는 LPDDR D램을 마치 HBM처럼 4층으로 적층한 제품이다.

VCS는 HBM에서 사용되는 DDR D램이 아닌 LPDDR 제품을 쌓은 것이 특징이다. LPDDR D램은 스마트폰, 노트북 PC 등 모바일 기기에 장착되는 D램이다. 저전력이라는 뜻인 ‘로 파워(Low Power)’의 앞 글자가 붙여졌는데 기존 DDR D램보다 전력 소모가 상당히 적다는 것을 나타낸다. 배터리 수명이 중요한 모바일 기기에 안성맞춤이다.

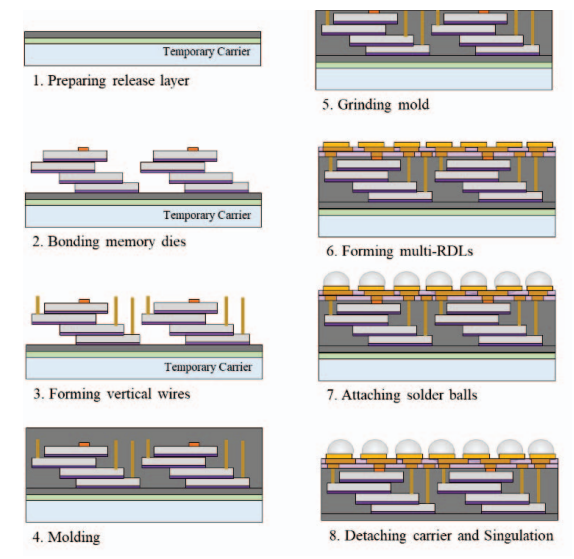

지금까지 정보기술(IT) 회사들은 LPDDR D램을 애플리케이션프로세서(AP) 옆에 모듈 형태로 장착했다. 삼성의 VCS 기술은 4층으로 쌓은 LPDDR D램을 AP 바로 위에 얹는 것이 다르다. LPDDR D램과 AP 사이의 거리가 짧아져서 앱 실행 속도나 AI 구현이 더욱 신속해질 수 있다. 데이터 이동 통로를 ‘수직 배선’으로 연결한 것 역시 D램 적층과 속도 개선에 도움을 준다.

SK하이닉스 역시 삼성전자가 쓰는 VCS D램이라는 이름이 아닌 ‘VFO’라는 이름으로 제품을 개발하고 있다. 5월 미국 덴버에서 열린 세계 최대 반도체 패키징 기술 학회인 ‘ECTC 2024’에서 삼성전자의 VCS와 유사한 형태의 VFO D램 콘셉트를 공개했다. SK하이닉스는 이 발표에서 “얇은 두께의 칩이 필요한 모바일 시장에서 최적의 솔루션이 될 것”이라며 “VFO의 기계적 우수성 등을 미뤄봤을 때 최고의 D램 제품으로 자리매김할 가능성이 있다”고 설명했다.

반도체 회사들이 LPDDR D램의 혁신을 모색하고 있는 것은 AI 시장에서 이 D램의 쓰임새가 더욱 늘어날 것으로 보고 있기 때문이다. 세계 IT ‘빅테크’들이 초대형 AI용 데이터센터를 구축하는 것 외에도 일반 소비자들이 AI를 직접 활용할 수 있는 온디바이스 기기가 시장 전반에 확산되고 있기 때문이다. 시장조사 업체 스태티스타에 따르면 AI PC 도입률은 올해 전체 PC 시장의 19%, 2027년에는 63%까지 오를 것으로 전망된다. AI PC에는 기존보다 더 많은 데이터 연산을 보조할 LPDDR D램이 필요한 만큼 노트북 PC의 평균 D램 탑재량이 최소 7% 증가할 것으로 관측된다.

LPDDR D램은 서버 시장에서까지 각광받는 추세다. 최근 AI 서버 시장에서는 전력 효율성 문제가 가장 큰 화두로 떠오르고 있다. HBM 역시 서버에서 큰 전력을 소비하는 것으로 알려졌는데 이 문제를 해결하기 위해 칩 회사들은 LPDDR D램을 적극적으로 활용하는 방안을 강구하고 있다. 엔비디아는 서버의 움직임을 총괄하는 ‘그레이스’라는 중앙처리장치(CPU)를 보조하는 D램으로 HBM이 아닌 LPDDR D램을 탑재해 화제가 됐다. 삼성전자도 자체 개발 중인 AI 추론 칩 ‘마하’를 LPDDR D램을 적용할 수 있는 반도체로 개발하고 있다.

이러한 성장세에 따라 시장조사 업체 옴디아는 세계 LPDDR D램의 매출이 지난해 123억 4000만 달러에서 2027년에는 255억 달러까지 증가할 것이라고 예측했다. 반도체 업계의 한 고위 관계자는 “LPDDR은 서버용 메모리보다 안전성이 떨어진다는 치명적인 단점이 있다”면서도 “전력 효율성이 더 큰 화두로 떠오르면서 서버에도 LPDDR을 적용하는 것이 트렌드로 떠오르는 추세”라고 말했다.

< 저작권자 ⓒ 서울경제, 무단 전재 및 재배포 금지 >

hjin@sedaily.com

hjin@sedaily.com